El error estándar se utiliza para medir la precisión estadística de una estimación. Se utiliza principalmente en el proceso de prueba de hipótesis e intervalo de estimación.

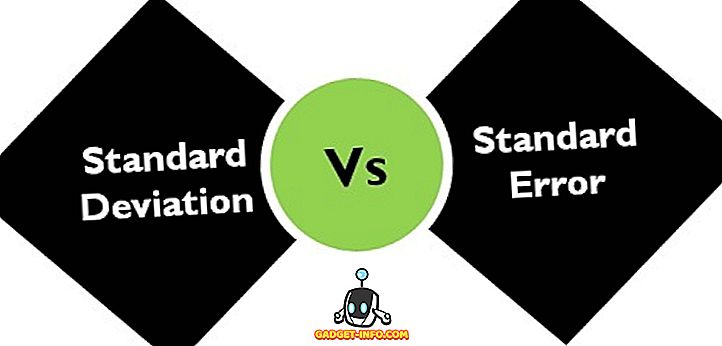

Estos son dos conceptos importantes de las estadísticas, que se utilizan ampliamente en el campo de la investigación. La diferencia entre la desviación estándar y el error estándar se basa en la diferencia entre la descripción de los datos y su inferencia.

Gráfica comparativa

| Bases para la comparación | Desviación estándar | Error estándar |

|---|---|---|

| Sentido | La desviación estándar implica una medida de dispersión del conjunto de valores de su media. | El error estándar connota la medida de exactitud estadística de una estimación. |

| Estadística | Descriptivo | Inferencial |

| Medidas | ¿Cuántas observaciones varían entre sí? | Cuán precisa significa la muestra a la verdadera población. |

| Distribución | Distribución de la observación en relación con la curva normal. | Distribución de una estimación relativa a la curva normal. |

| Fórmula | Raíz cuadrada de la varianza | Desviación estándar dividida por la raíz cuadrada del tamaño de la muestra. |

| Aumento del tamaño de la muestra. | Da una medida más específica de la desviación estándar. | Disminuye el error estándar. |

Definición de desviación estándar

La desviación estándar, es una medida de la extensión de una serie o la distancia de la norma. En 1893, Karl Pearson acuñó la noción de desviación estándar, que es sin duda la medida más utilizada, en estudios de investigación.

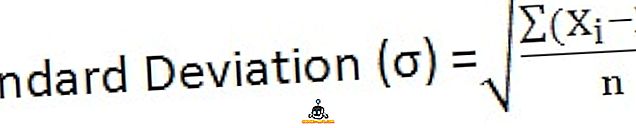

Es la raíz cuadrada de la media de cuadrados de desviaciones de su media. En otras palabras, para un conjunto de datos dado, la desviación estándar es la desviación cuadrática media de la media aritmética. Para toda la población, se indica con la letra griega 'sigma (σ)', y para una muestra, se representa con la letra latina 's'.

La desviación estándar es una medida que cuantifica el grado de dispersión del conjunto de observaciones. Cuanto más alejados estén los puntos de datos del valor medio, mayor será la desviación dentro del conjunto de datos, lo que representa que los puntos de datos están dispersos en un rango más amplio de valores y viceversa.

- Para datos no clasificados:

- Para la distribución de frecuencia agrupada:

Definición de error estándar

Es posible que haya observado que diferentes muestras, con tamaño idéntico, extraídas de la misma población, darán diversos valores de estadística bajo consideración, es decir, media muestral. El error estándar (SE) proporciona la desviación estándar en diferentes valores de la media de la muestra. Se utiliza para hacer una comparación entre medias muestrales en todas las poblaciones.

En resumen, el error estándar de una estadística no es más que la desviación estándar de su distribución muestral. Tiene un gran papel para jugar la prueba de hipótesis estadística y estimación de intervalo. Da una idea de la exactitud y fiabilidad de la estimación. Cuanto menor es el error estándar, mayor es la uniformidad de la distribución teórica y viceversa.

- Fórmula : Error estándar para la media de la muestra = σ / √n

Donde, σ es la desviación estándar de la población

Diferencias clave entre la desviación estándar y el error estándar

Los puntos que se indican a continuación son sustanciales en lo que respecta a la diferencia entre la desviación estándar:

- La desviación estándar es la medida que evalúa la cantidad de variación en el conjunto de observaciones. El error estándar mide la precisión de una estimación, es decir, es la medida de la variabilidad de la distribución teórica de una estadística.

- La desviación estándar es una estadística descriptiva, mientras que el error estándar es una estadística inferencial.

- La desviación estándar mide qué tan lejos están los valores individuales del valor medio. Por el contrario, qué tan cerca está la media de la muestra a la media de la población.

- La desviación estándar es la distribución de observaciones con referencia a la curva normal. En contra de esto, el error estándar es la distribución de una estimación con referencia a la curva normal.

- La desviación estándar se define como la raíz cuadrada de la varianza. A la inversa, el error estándar se describe como la desviación estándar dividida por la raíz cuadrada del tamaño de la muestra.

- Cuando el tamaño de la muestra aumenta, proporciona una medida más particular de la desviación estándar. A diferencia del error estándar, cuando aumenta el tamaño de la muestra, el error estándar tiende a disminuir.

Conclusión

En general, la desviación estándar es considerada como una de las mejores medidas de dispersión, que mide la dispersión de valores del valor central. Por otro lado, el error estándar se usa principalmente para verificar la confiabilidad y precisión de la estimación y, por lo tanto, cuanto más pequeño sea el error, mayor es su confiabilidad y precisión.